损失函数与优化

SVM分类

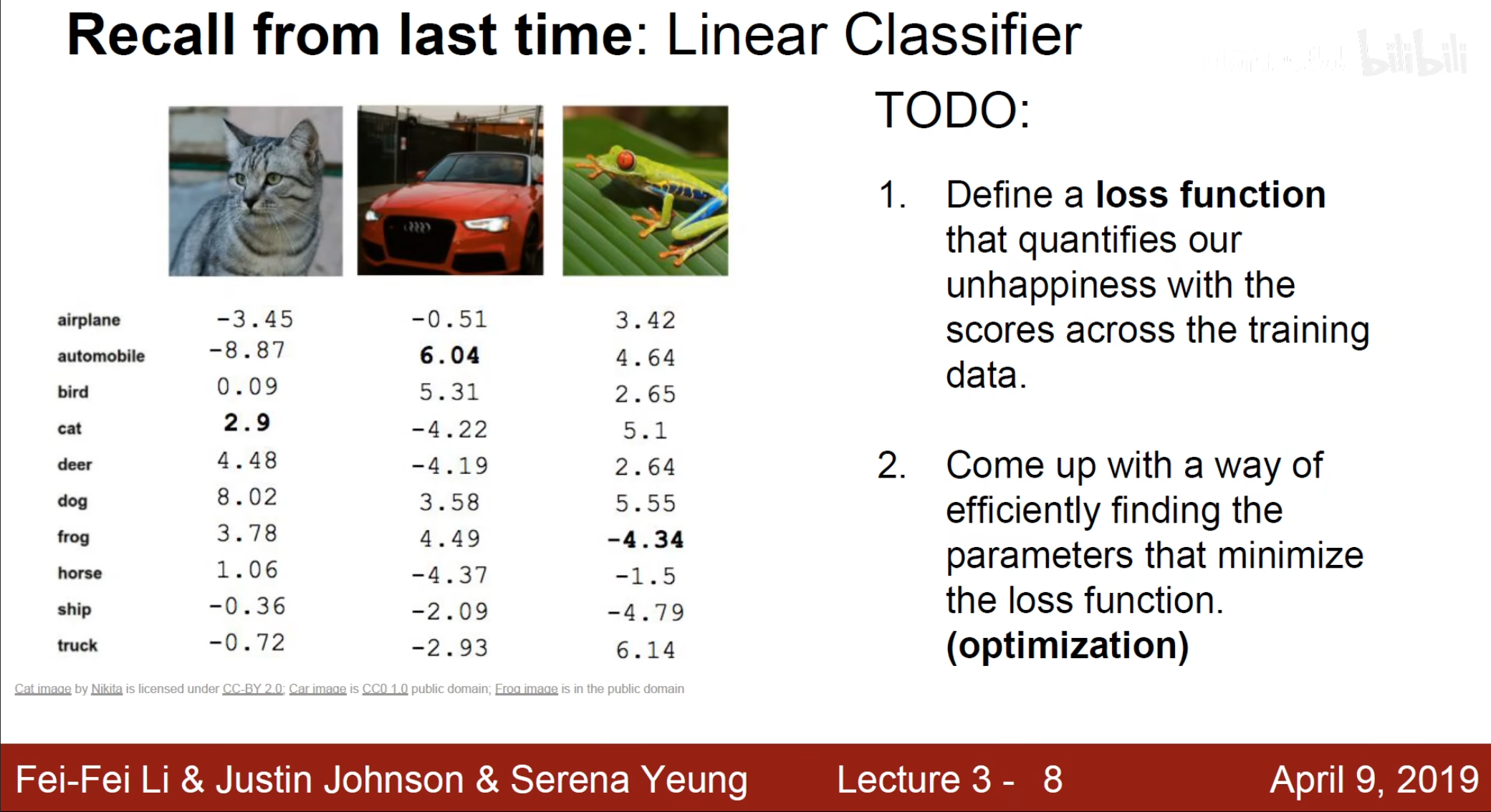

上一节已经介绍了线性分类器,但是我们并没有对其进行评估。现在我们需要对其进行评估,首先定义一个损失函数,接着然后对其进行优化,使其$ loss $最小化。

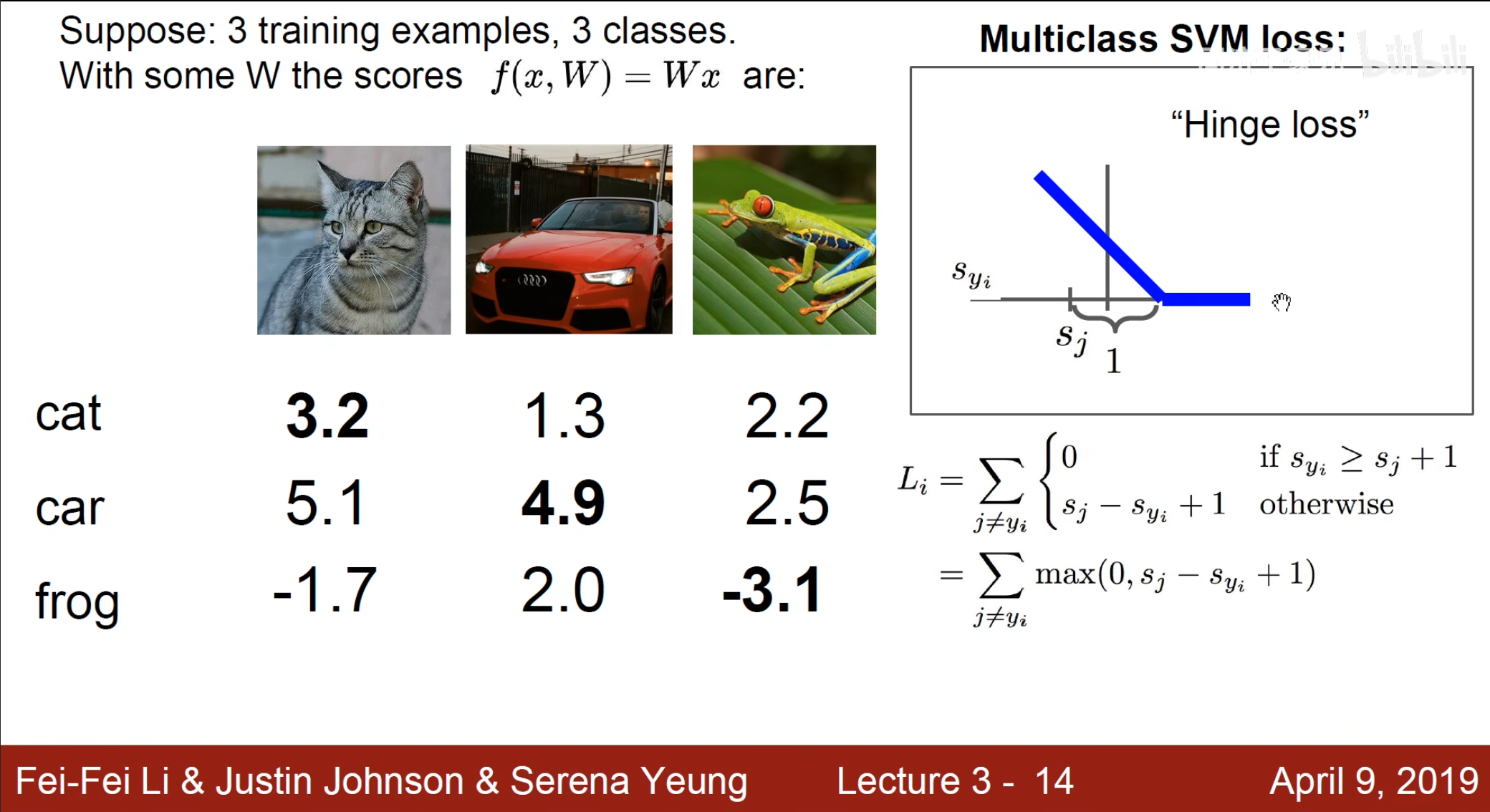

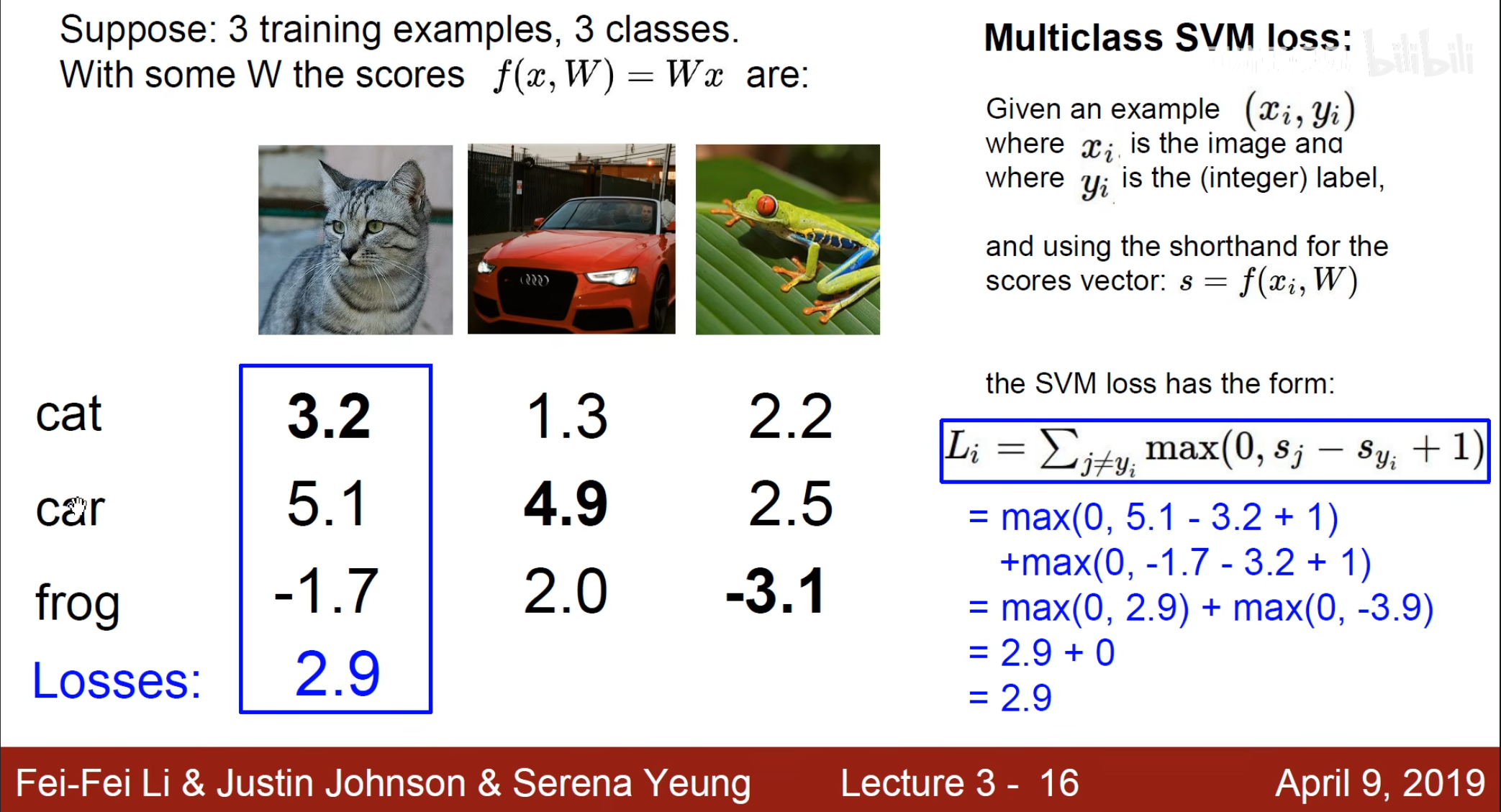

首先使用$ SVM $分类,对于这个算法在这里不多介绍,具体在机器学习中详细介绍,这里直接使用它的损失函数,也就是前面提到的合页函数,但是需要注意的是,这里的损失函数并不是前面直接使用目标值和预测值的乘积,在实际应用的时候,一方面,预测值$ y $并不总是属于$ [-1,1] $,也可能属于其他的取值范围;另一方面,很多时候我们希望训练的是两个元素之间的相似关系,而非样本的类别得分,因此我们更倾向于使用二者的差值预测二者之间的相似关系。

当我们对于猫这张图片进行计算的时候,可以看到这个损失函数的值就是$ 2.9 $

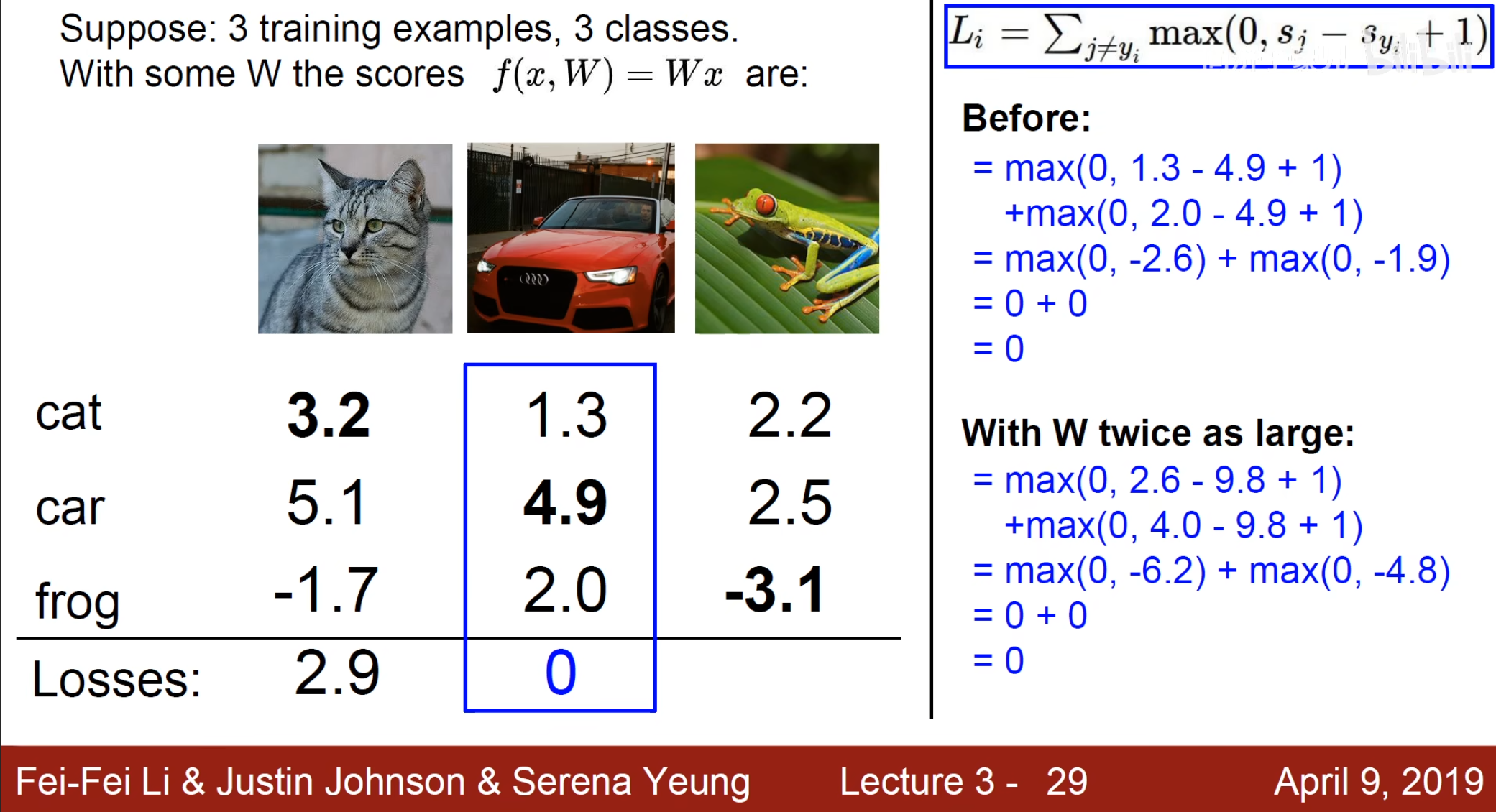

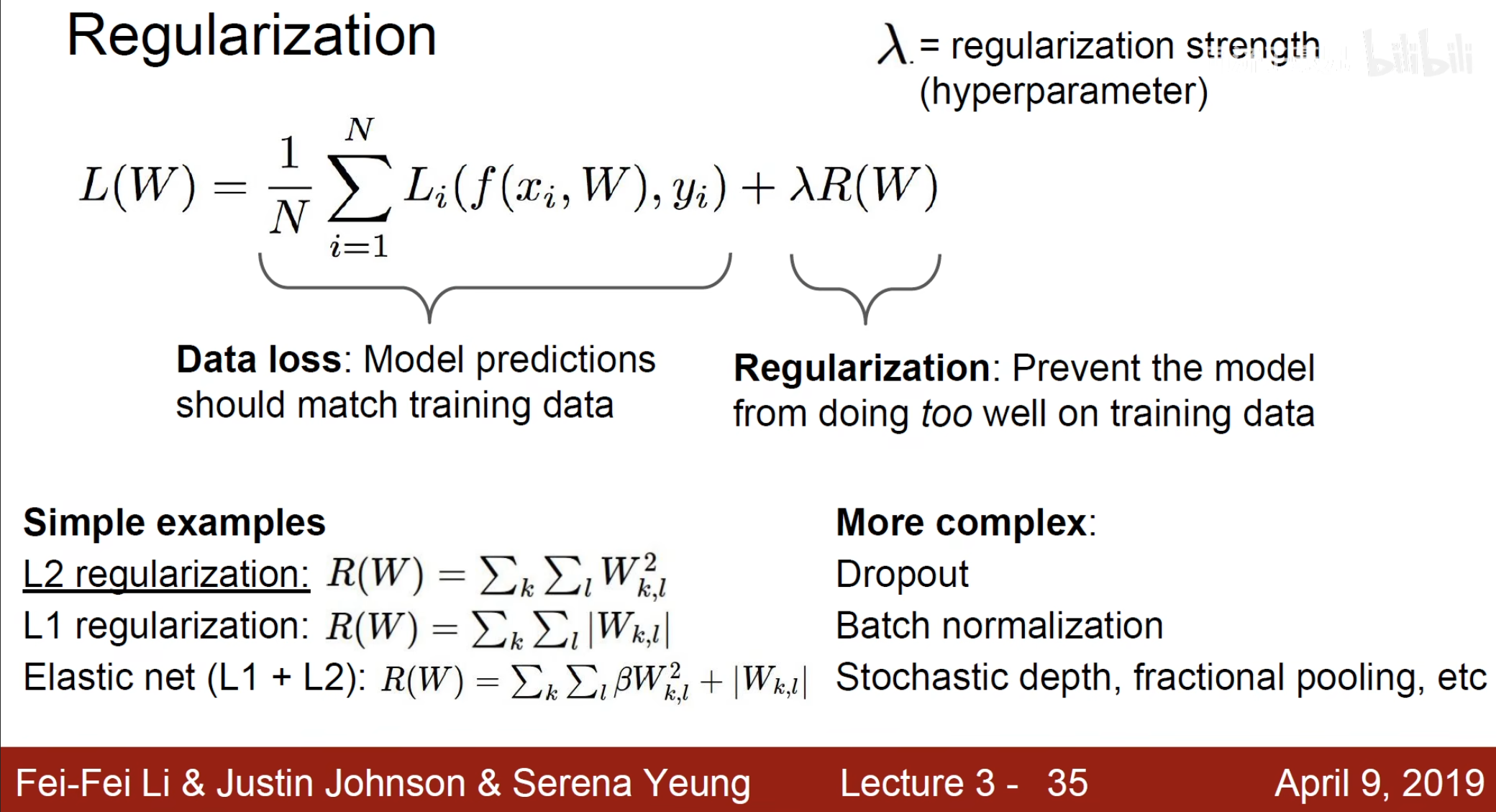

可以看到即使两个$ w $的值不同,但只要是关系,那么损失值也是相同的,那么如何衡量使用合适的权重,这就需要使用正则化。

图中展示了我们进行使用的$ L1,L2 $正则化,以及$ Dropout $等避免过拟合的方法。

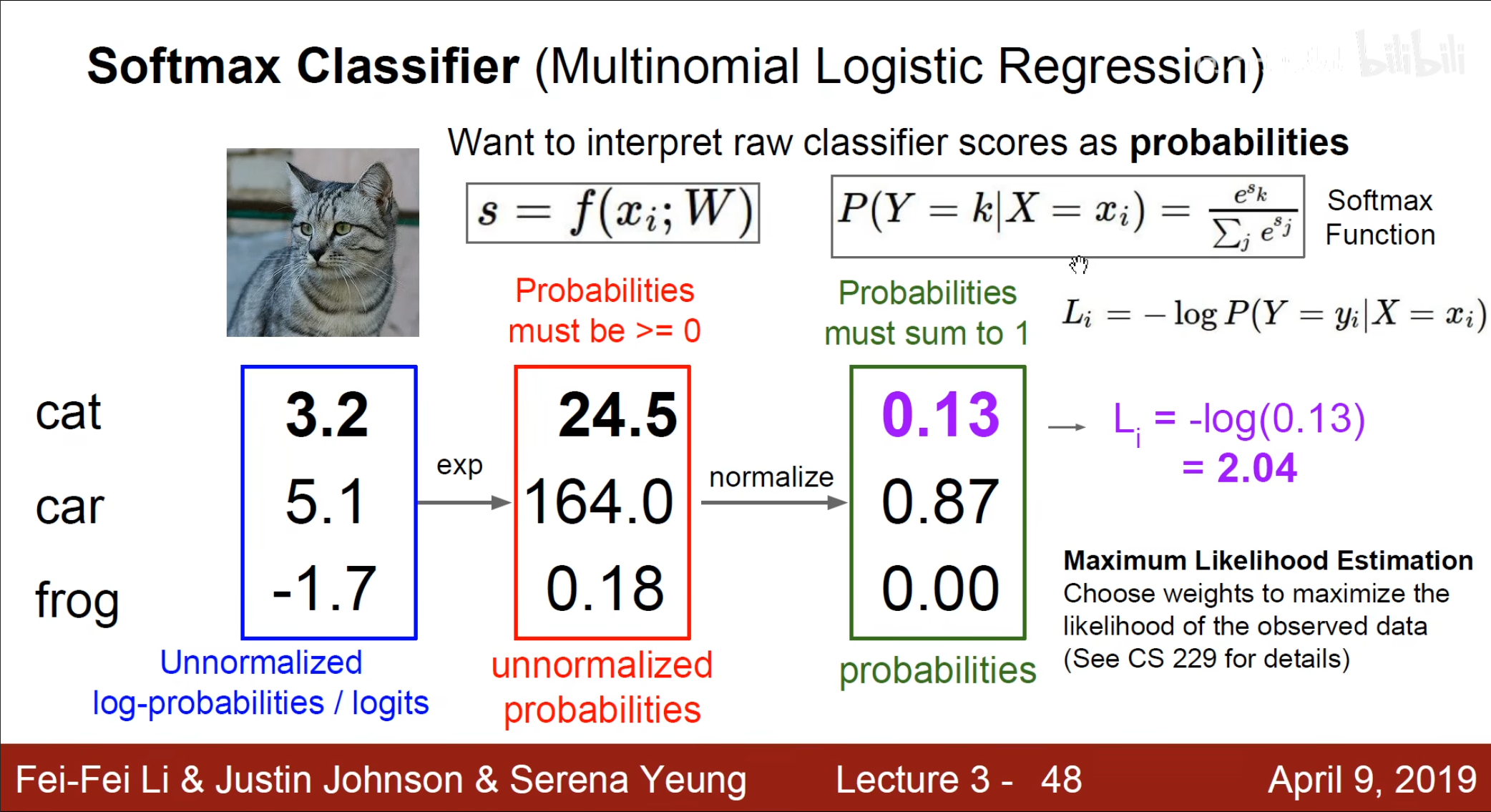

softmax分类

除了上一节的$ SVM $,对于分类问题,例如对于多分类的逻辑回归问题,我们还可以使用$ softmax $激活函数,因此可以计算出不同类型的概率,还可以使用最大似然估计求得损失函数,这一部分也是属于机器学习的内容,这里不过多阐述。